Implementación

Esta sección solo cubre el trabajo con Face Analytics en la consola de Catalyst. Consulta las secciones de documentación del SDK y la API para implementar Face Analytics en el código de tu aplicación.

Como se mencionó anteriormente, puedes acceder a las plantillas de código que te permitirán integrar Face Analytics en tu aplicación de Catalyst desde la consola, y también probar la función subiendo imágenes con rostros y obteniendo los resultados.

Acceder a Face Analytics

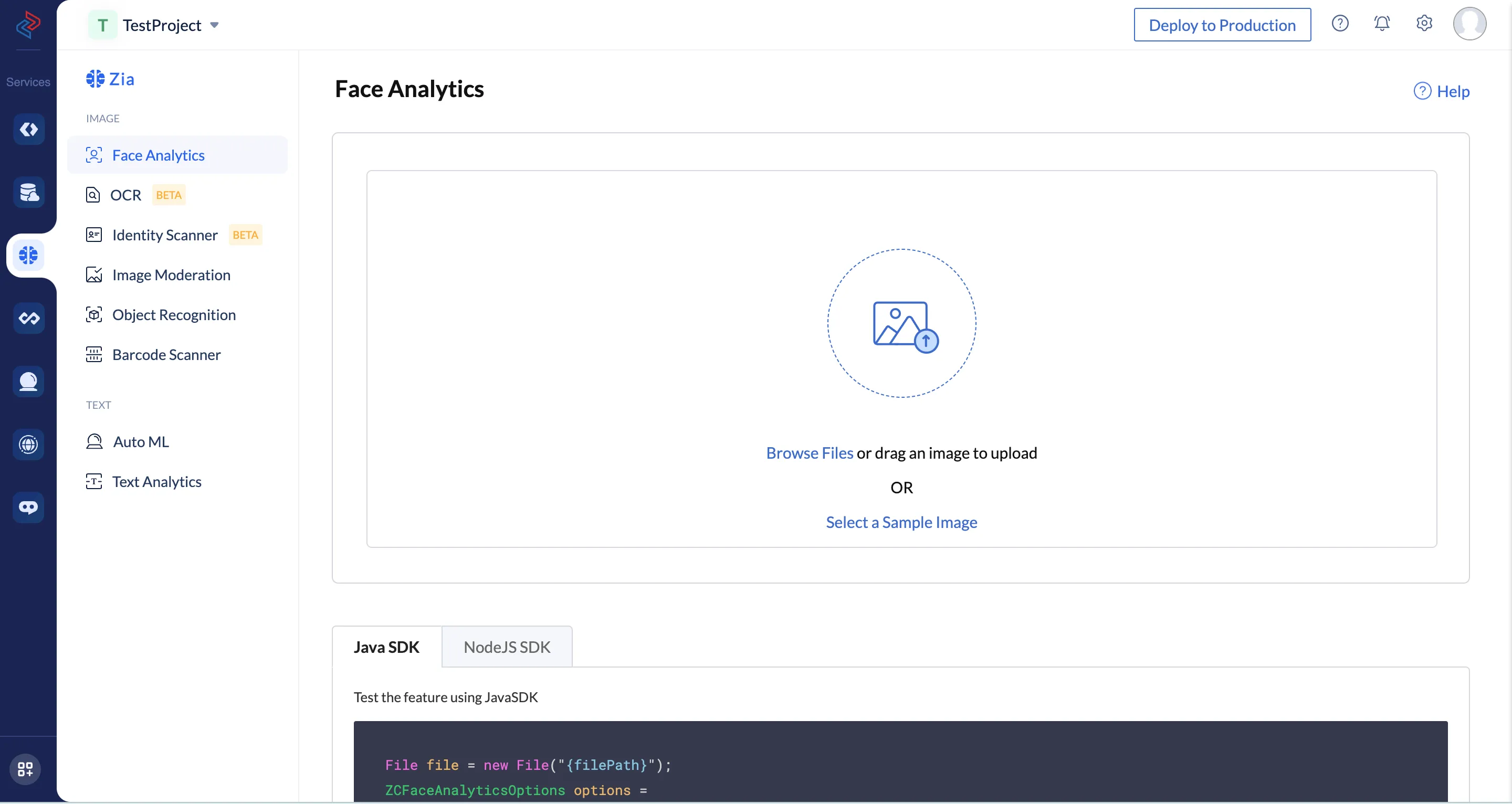

Para acceder a Face Analytics en tu consola de Catalyst:

- Navega a Zia Services en el panel izquierdo de la consola de Catalyst y haz clic en Face Analytics.

- Haz clic en Try a Demo y esto abrirá la función Face Analytics.

Probar Face Analytics en la consola de Catalyst

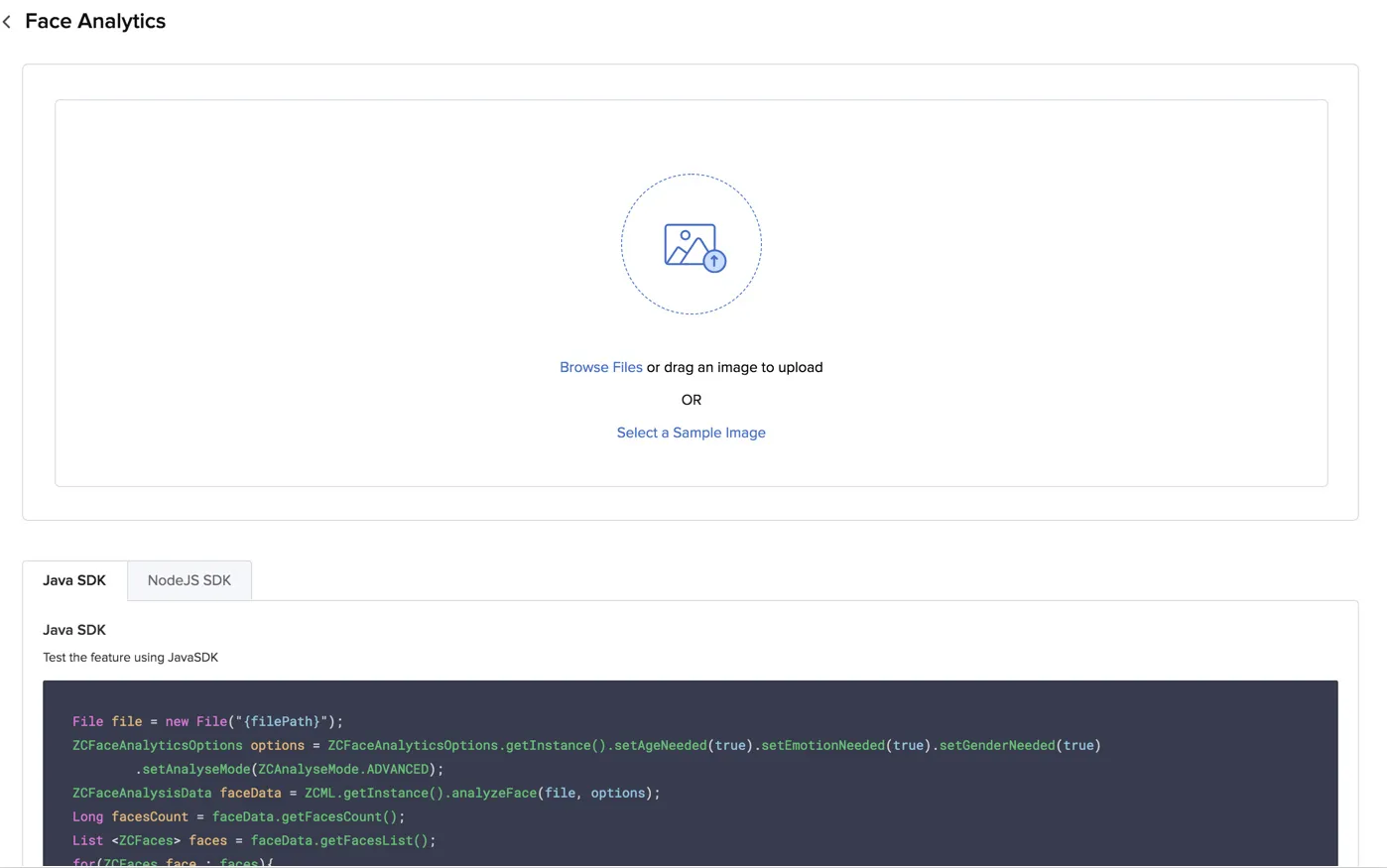

Puedes probar Face Analytics seleccionando una imagen de muestra de Catalyst o subiendo tu propia imagen.

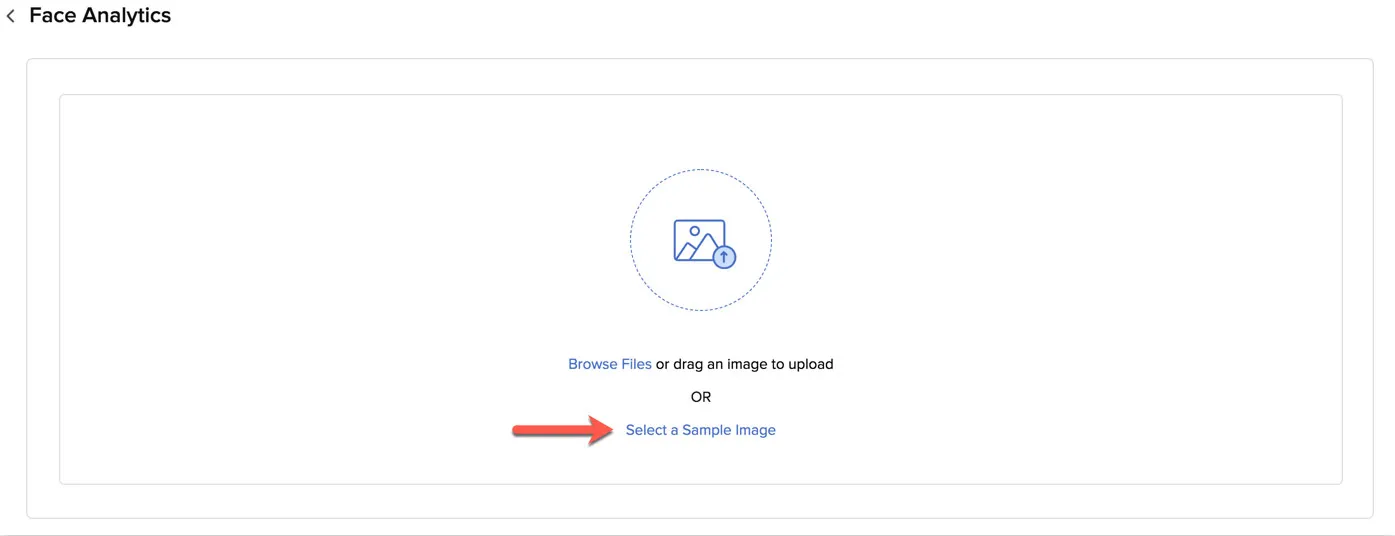

Para escanear una imagen de muestra con un rostro y ver el resultado:

- Haz clic en Select a Sample Image en el cuadro.

- Selecciona una imagen de las muestras proporcionadas.

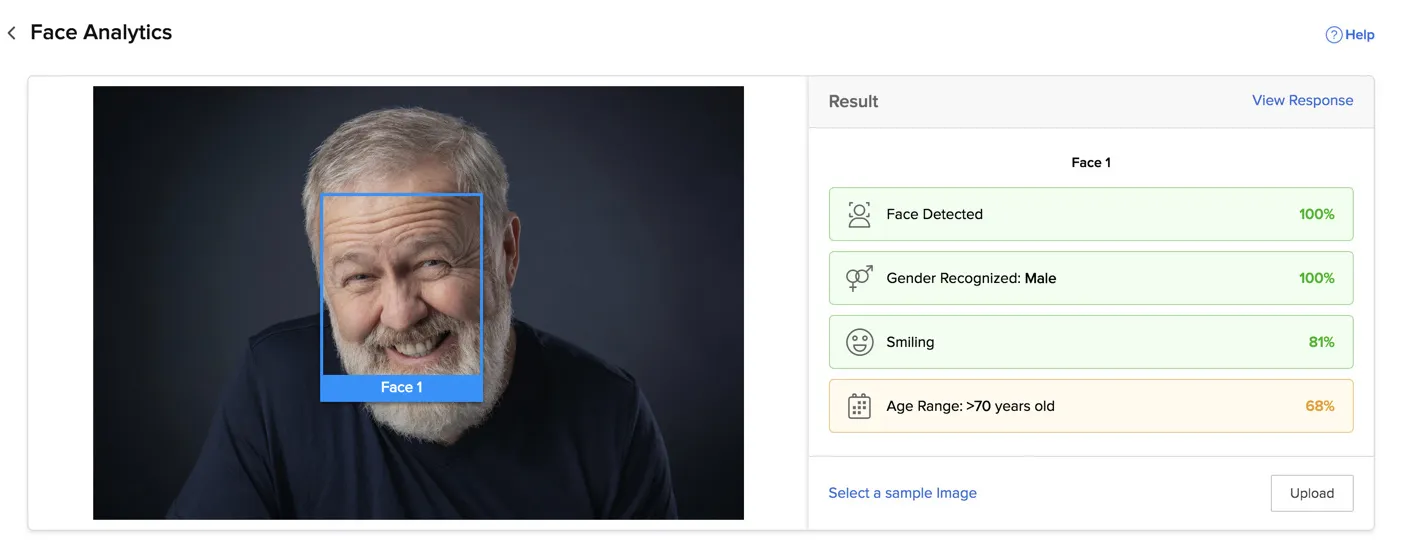

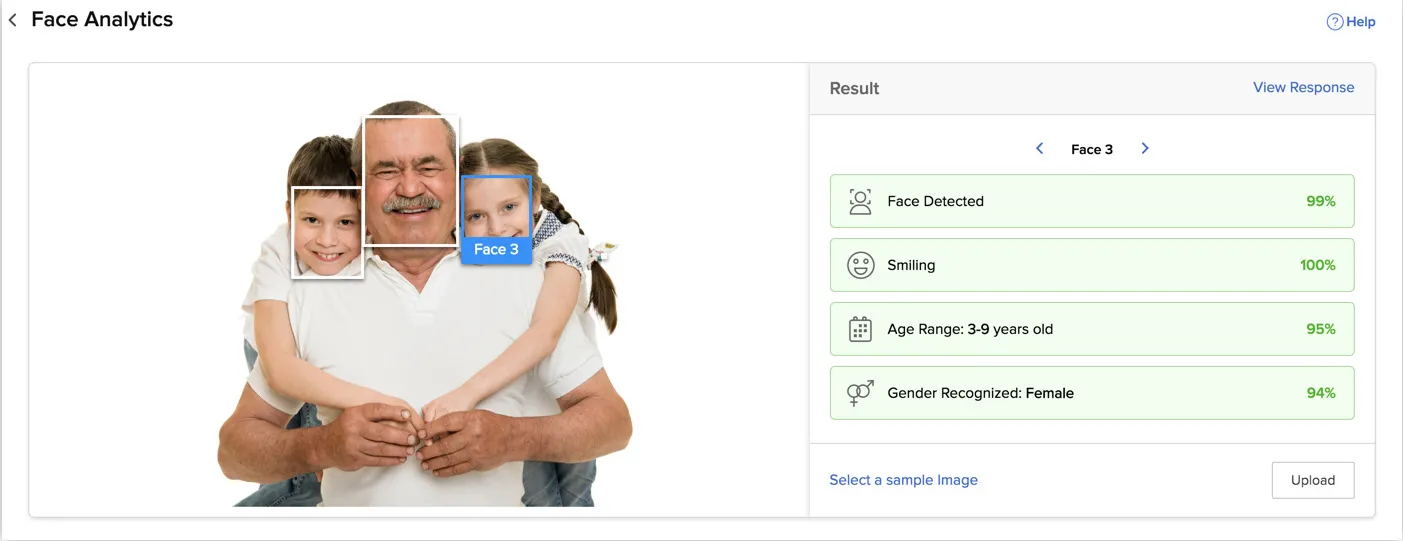

Face Analytics escaneará la imagen en busca de rostros, analizará y predecirá los atributos, y proporcionará un resultado textual del análisis y el nivel de confianza de cada predicción en valores porcentuales, para cada rostro detectado.

Los colores en las barras de respuesta indican el rango del porcentaje de confianza de una predicción como: rojo: 0-30%, naranja: 30-80%, verde: 80-100%.

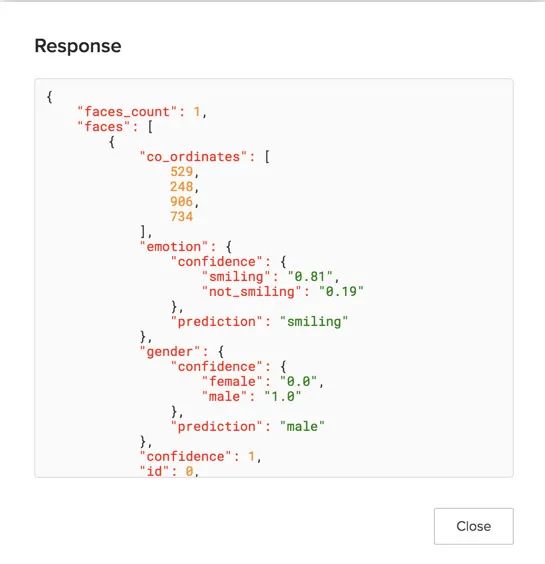

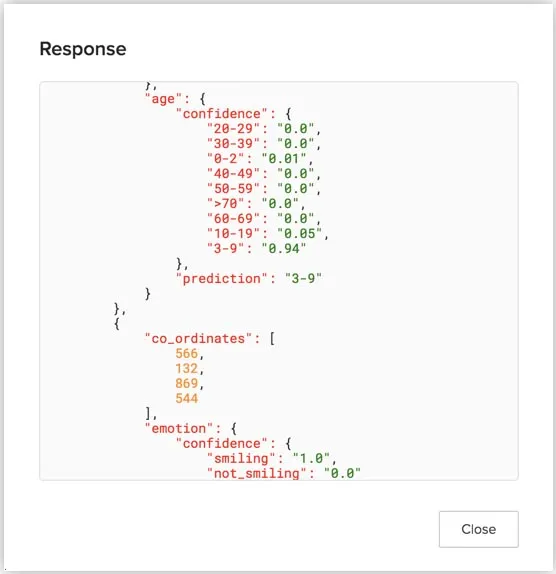

Las coordenadas generales y las coordenadas de los puntos de referencia localizados de cada rostro se proporcionan, además de las otras detecciones, en la respuesta JSON en el modo de localización de puntos de referencia avanzado por defecto. Haz clic en View Response para ver la respuesta JSON.

Puedes consultar la documentación de la API para ver una estructura completa de respuesta JSON de muestra.

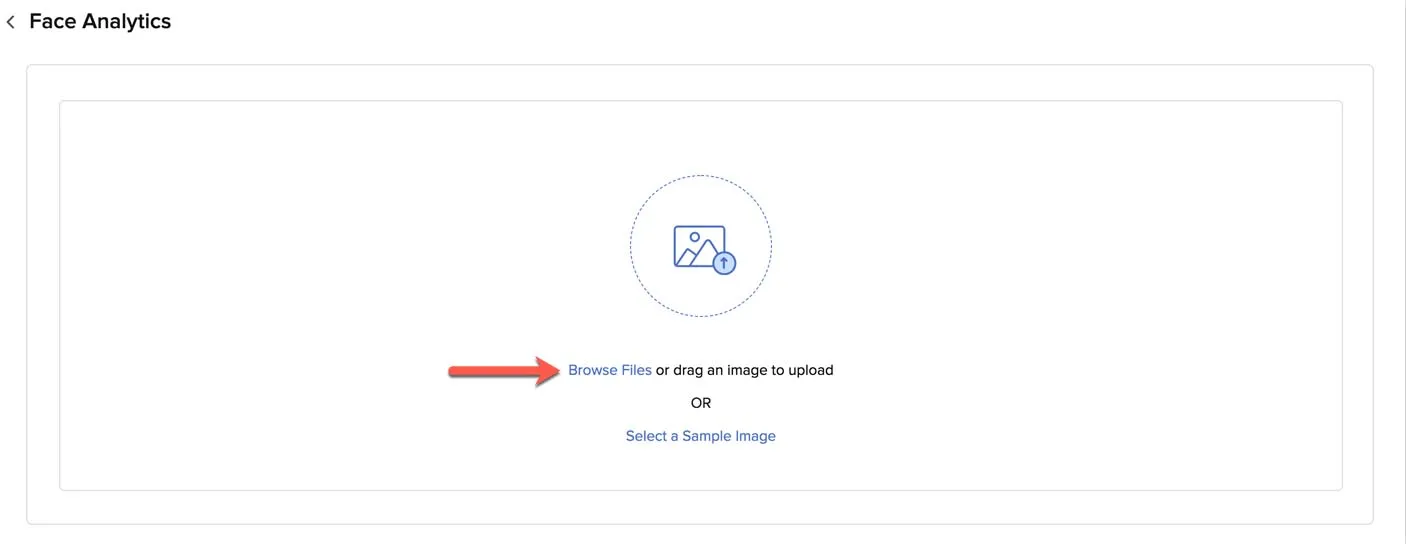

Para subir tu propia imagen y probar Face Analytics:

- Haz clic en Upload en la sección Result.

Si estás abriendo Face Analytics después de haberlo cerrado, haz clic en Browse Files en este cuadro.

- Sube un archivo desde tu sistema local.

Como se mencionó anteriormente, Face Analytics puede detectar y analizar los atributos de hasta 10 rostros en una imagen. Puedes verificar los resultados de cada rostro detectado haciendo clic en las flechas laterales. La respuesta JSON también contiene los resultados de cada rostro detectado.

Acceder a plantillas de código para Face Analytics

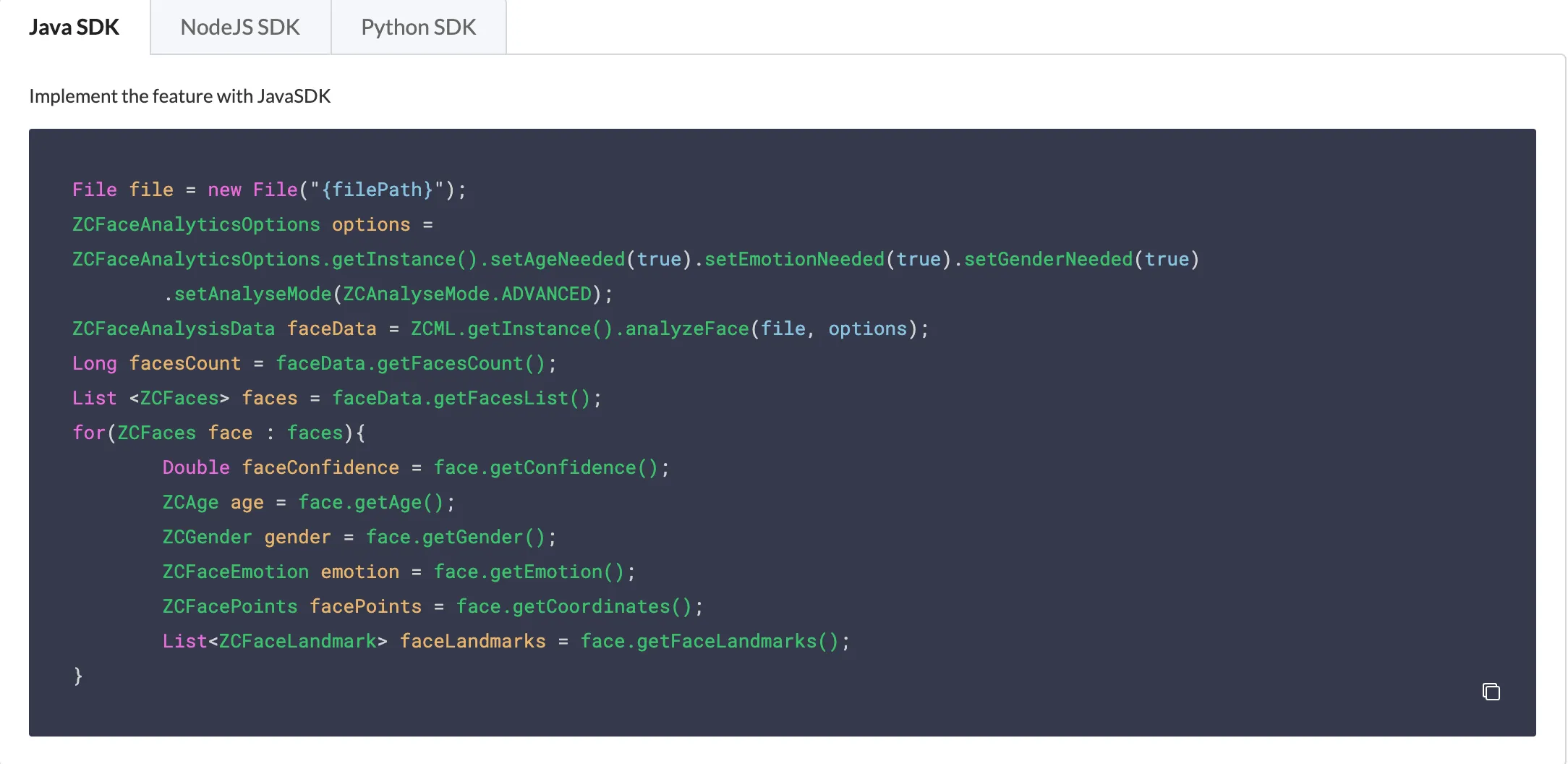

Puedes implementar Face Analytics en tu aplicación de Catalyst usando las plantillas de código proporcionadas por Catalyst para las plataformas Java, Node.js y Python.

Puedes acceder a ellas desde la sección debajo de la ventana de pruebas. Haz clic en la pestaña Java SDK, NodeJS SDK o Python SDK, y copia el código usando el icono de copiar. Puedes pegar este código en el código de tu aplicación web o Android donde lo necesites.

Puedes procesar el archivo de entrada como un nuevo File en Java. El módulo ZCFaceAnalyticsOptions te proporciona la opción de habilitar o deshabilitar el análisis de cada atributo. Por ejemplo, si estableces setAgeNeeded como false, Face Analytics no proporcionará los resultados de predicción de edad para los rostros detectados en la imagen. También puedes establecer el modo de localización de puntos de referencia como BASIC, MODERATE o ADVANCED usando setAnalyseMode.

En Node.js, el objeto facePromise se usa para contener el archivo de imagen de entrada y las opciones configuradas para él. Puedes especificar el mode como basic, moderate o advanced, y establecer un atributo como true o false para habilitar o deshabilitar el análisis del mismo.

En Python, el método analyse_face() acepta la imagen de entrada como su argumento. También puedes especificar el modo de análisis como basic, moderate o advanced. También puedes especificar los atributos age, smile o gender como true para detectar o false para no detectar. Estos valores son opcionales. Todos los atributos se detectan y el modo advanced se procesa por defecto.

Última actualización 2026-03-20 21:51:56 +0530 IST

Yes

No

Send your feedback to us