Crear un data pipeline

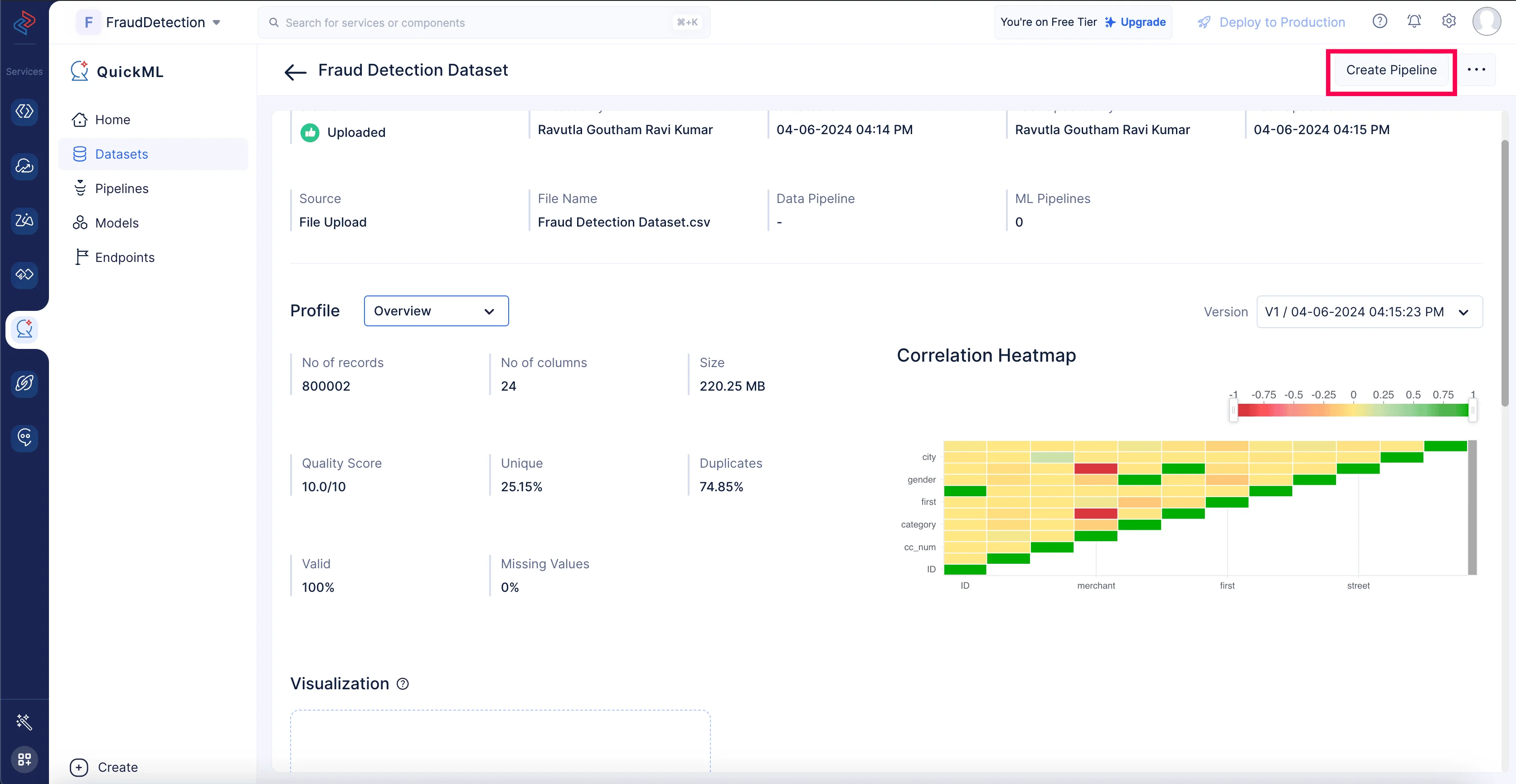

Ahora que hemos subido el dataset, procederemos a crear un data pipeline con el dataset.

-

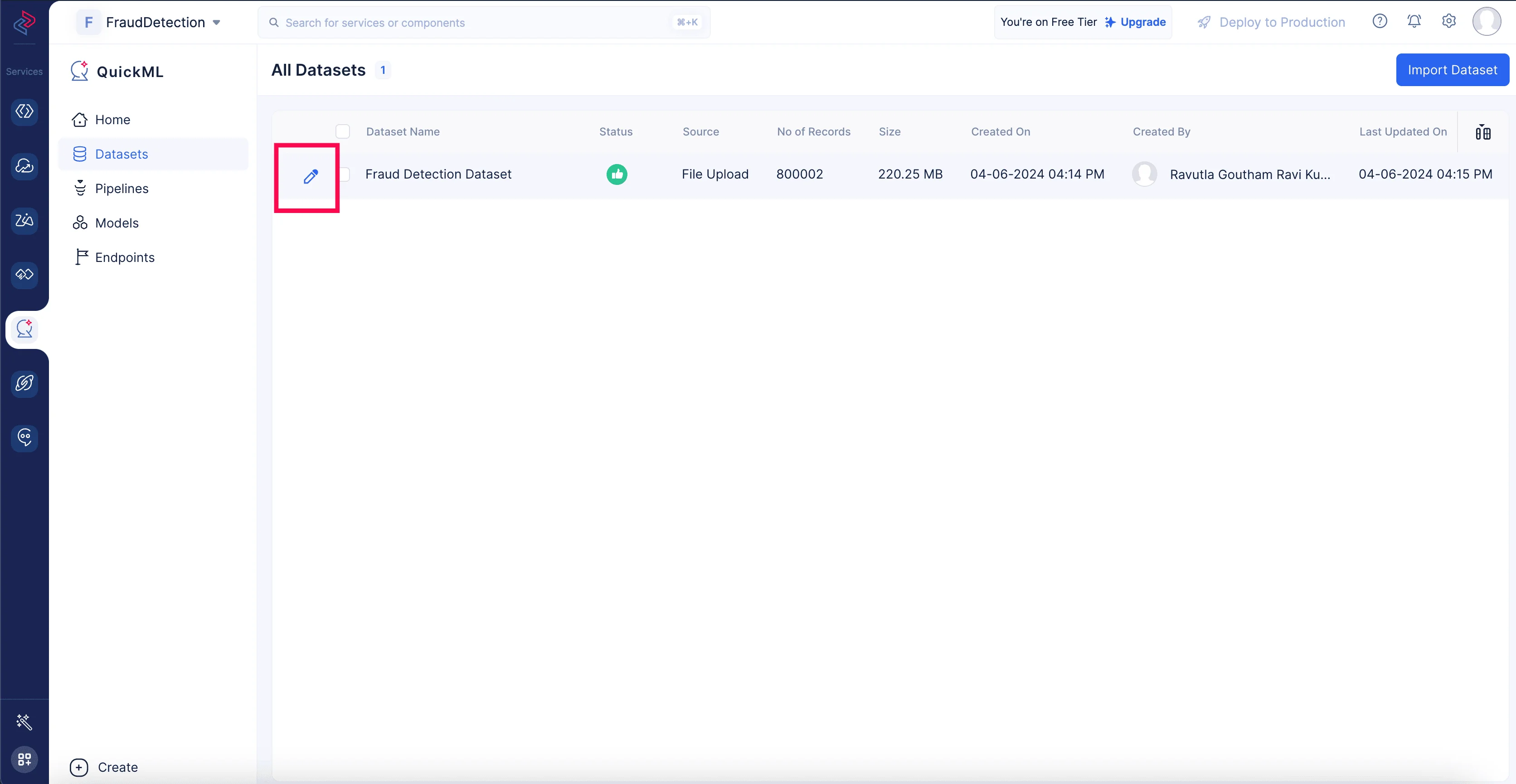

Navega al componente Datasets en el menú izquierdo. Hay dos formas de crear un data pipeline:

-

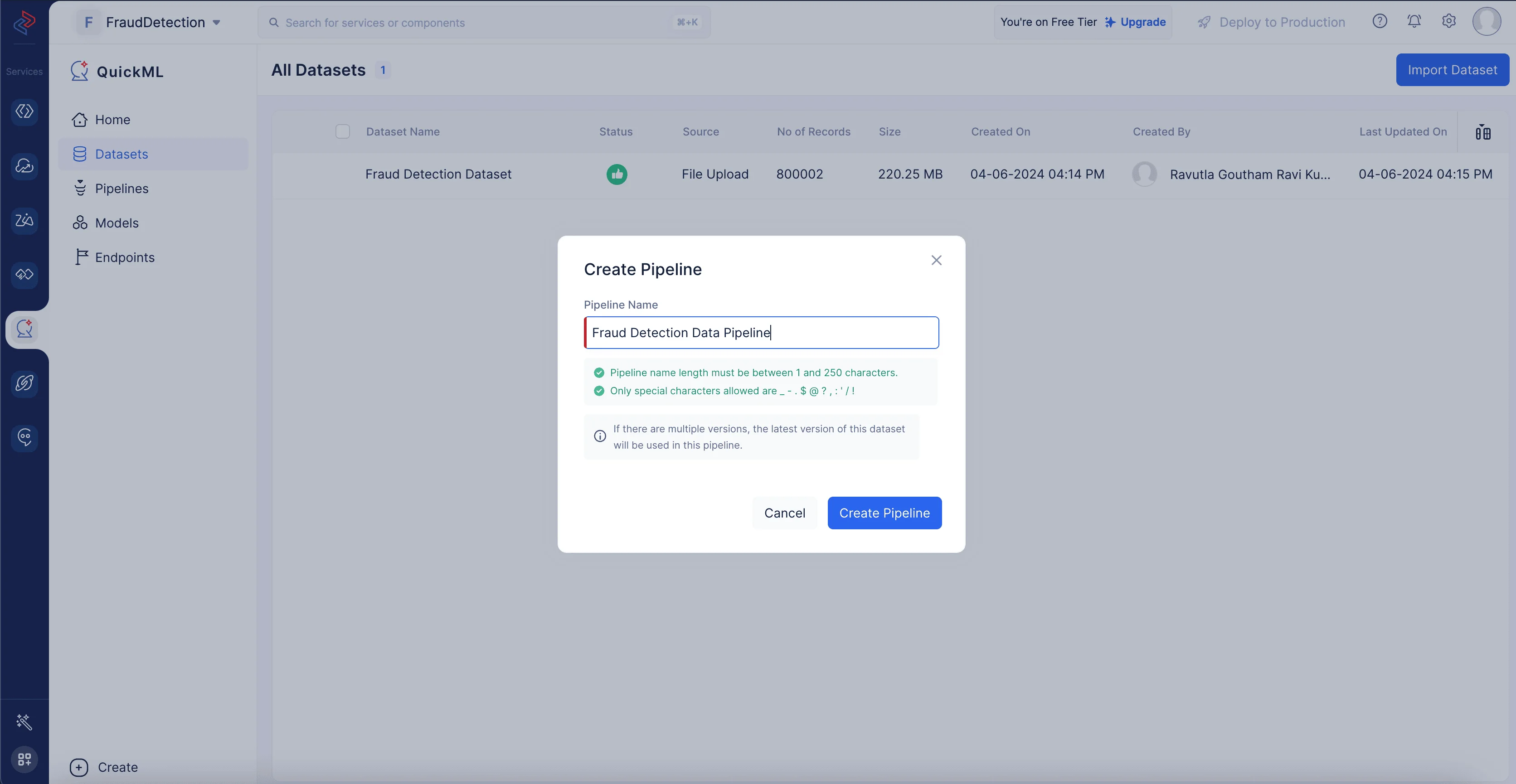

Nombra el pipeline “Fraud Detection Data Pipeline” y haz clic en Create Pipeline.

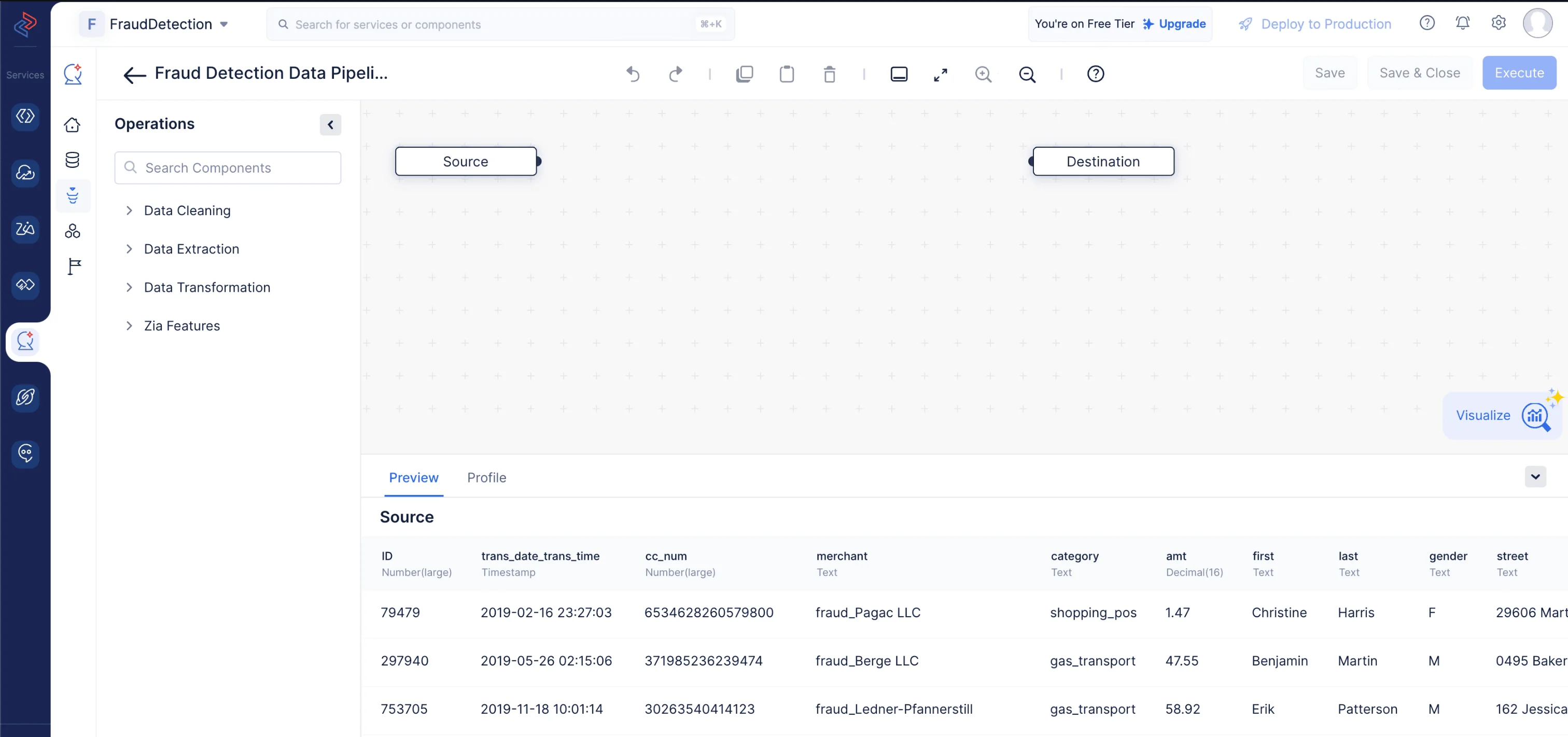

La interfaz del pipeline builder se abrirá como se muestra en la captura de pantalla a continuación.

Realizaremos el siguiente conjunto de operaciones de preprocesamiento de datos para limpiar, refinar y transformar los datasets, y luego ejecutar el data pipeline. Cada una de estas operaciones involucra nodos de datos individuales que se usan para construir el pipeline.

Preprocesamiento de datos con QuickML

-

Seleccionar/eliminar columnas

Seleccionar o eliminar columnas de un dataset es un paso común de preprocesamiento de datos en análisis de datos y aprendizaje automático. La elección de seleccionar o eliminar columnas depende de los objetivos específicos y los requisitos de tu análisis o tarea de modelado. Las columnas que no necesitamos para el entrenamiento de nuestro modelo de este dataset son “ID”, “trans_date_trans_time”, “cc_num”, “Merchant”, “First”, “Last”, “Street”, “City”, “Zip”, “Lat”, “Long”, “job”, “dob”, “Trans_num”, “Unix_Time”, “merch_lat”, “merch_long” en los datasets proporcionados. Usando QuickML, puedes seleccionar rápidamente los campos necesarios del dataset para el entrenamiento del modelo usando el nodo Select/Drop del componente Data Cleaning.

-

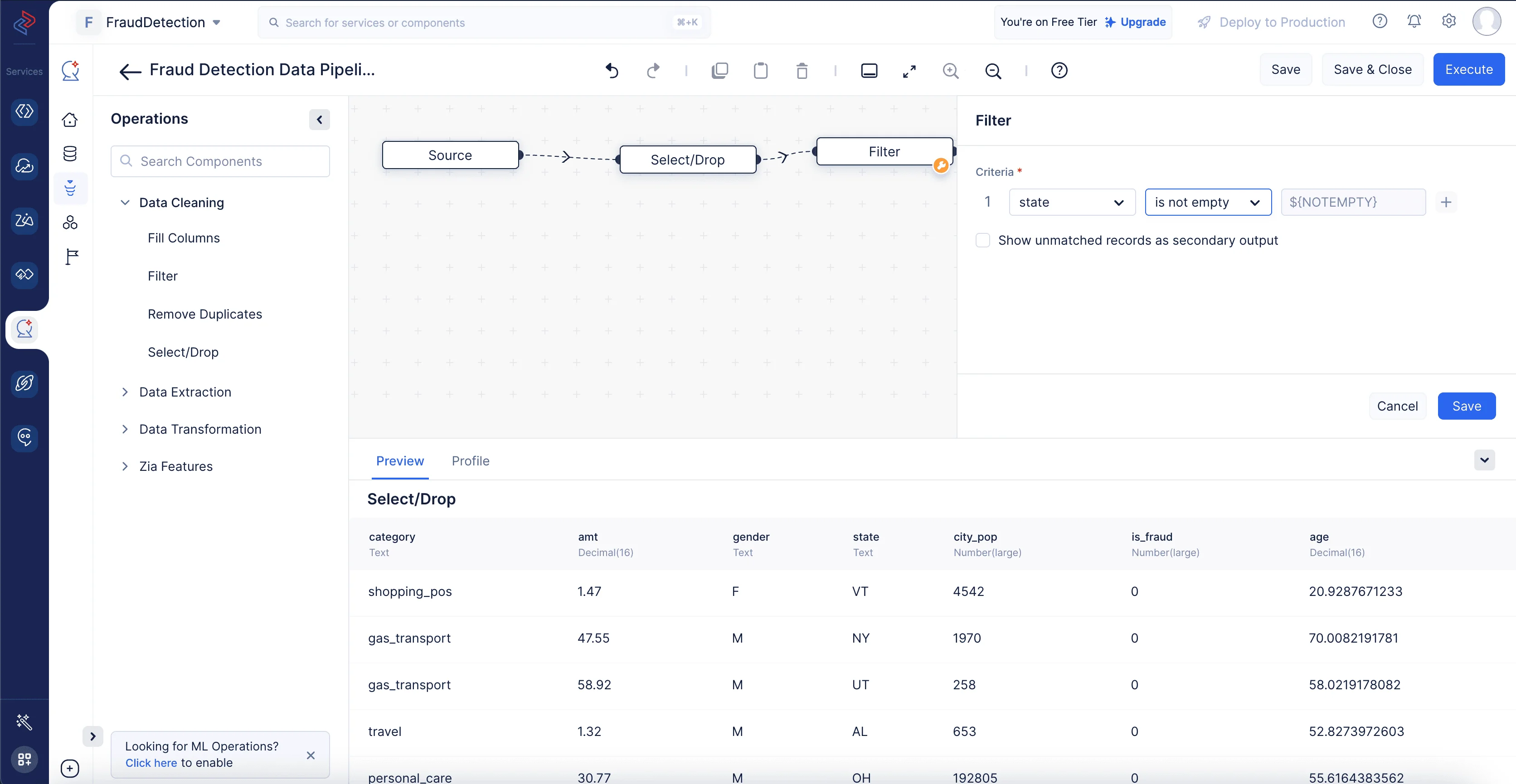

Filtrar datos

Filtrar un dataset típicamente involucra seleccionar un subconjunto de filas de un DataFrame que cumplen ciertos criterios o condiciones. Aquí estamos usando el nodo Filter de la sección Data Cleaning para filtrar la columna “state” cuyos valores no están vacíos.

-

Guardar y ejecutar

Ahora, conecta el nodo Filter al nodo Destination. Una vez que todos los nodos estén conectados, haz clic en el botón Save para guardar el pipeline. Luego haz clic en el botón Execute para ejecutar el pipeline.

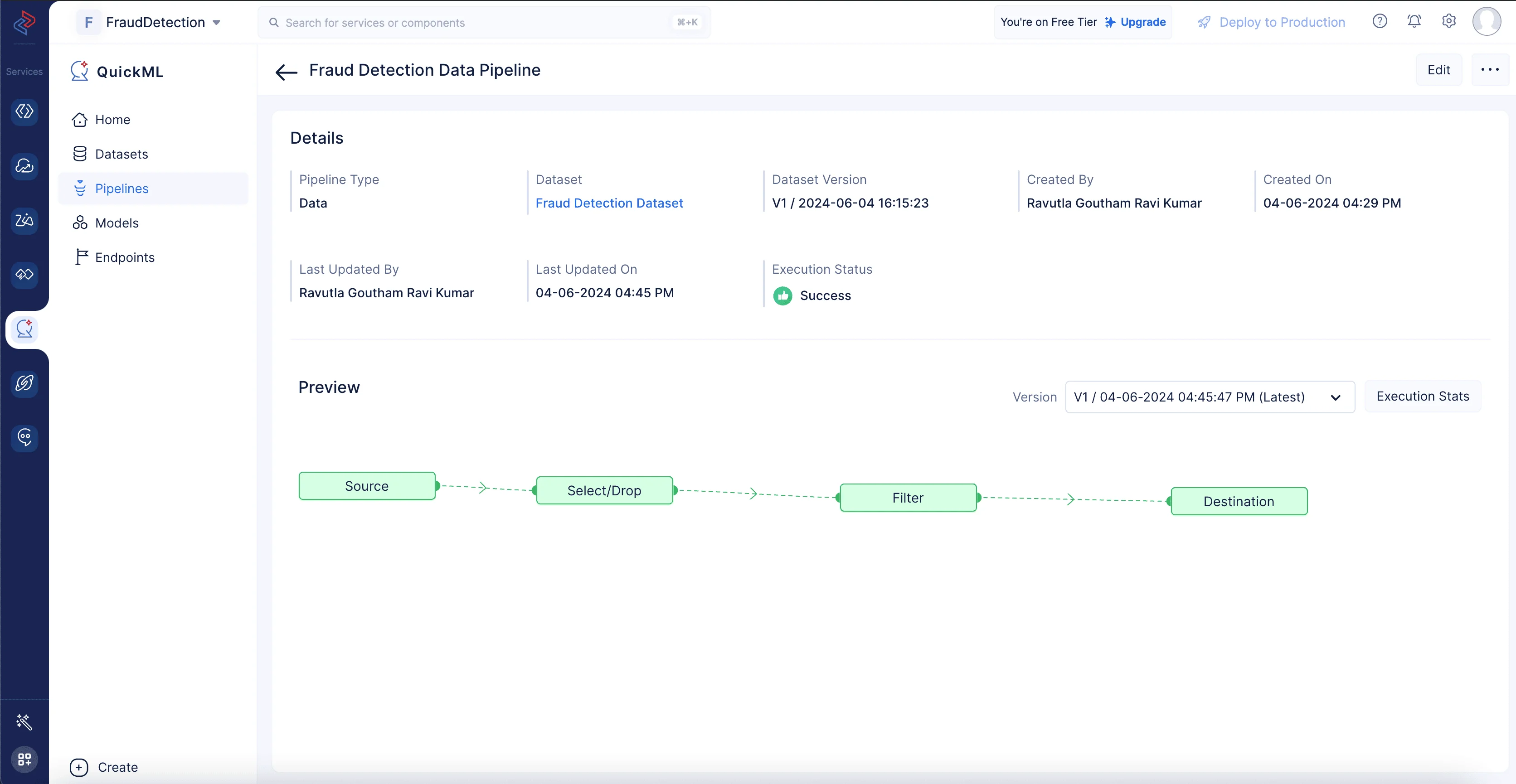

Serás redirigido a la página que se muestra a continuación, que muestra el pipeline ejecutado con el estado de ejecución. Podemos ver aquí que la ejecución del pipeline fue exitosa.

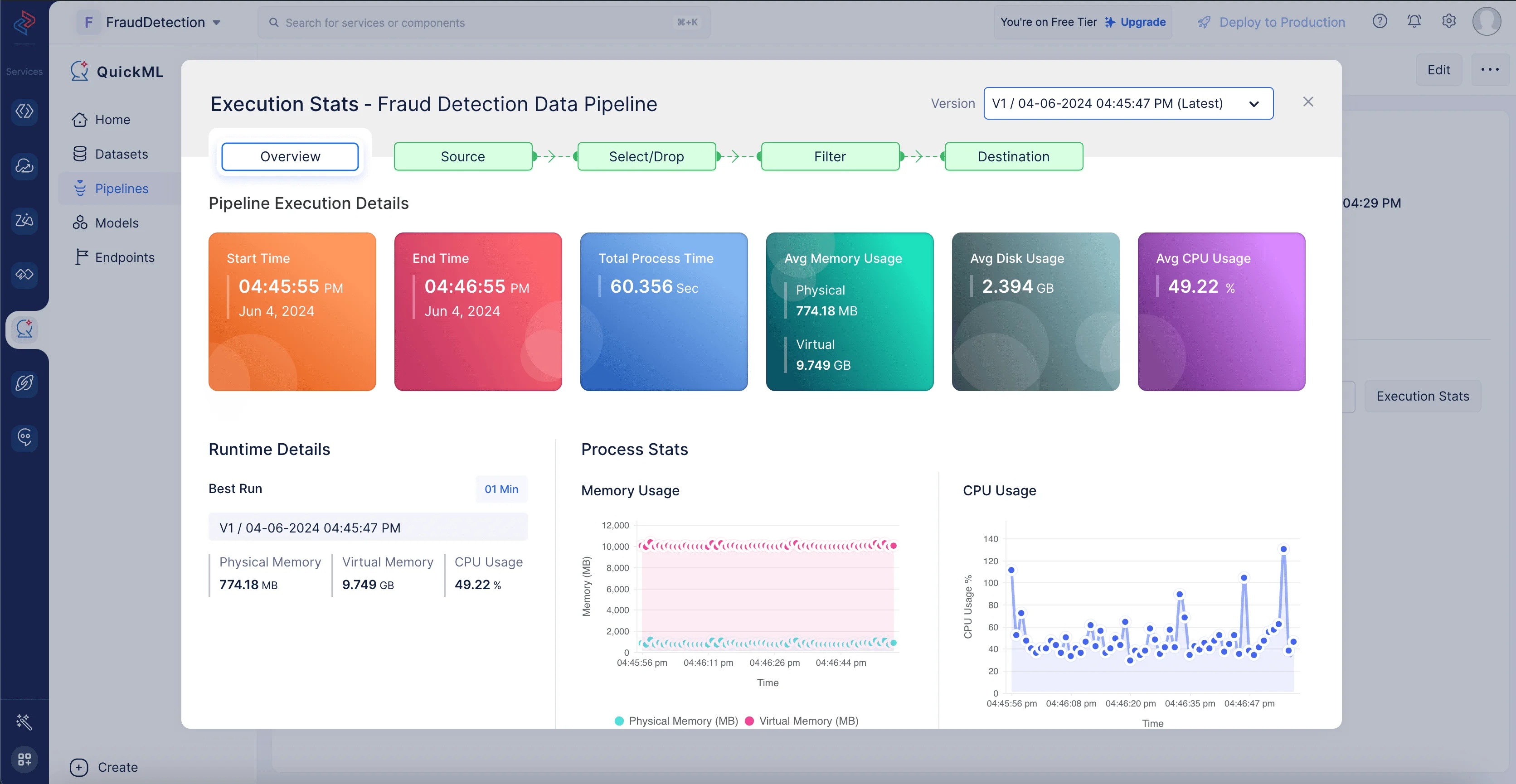

Haz clic en Execution Stats para acceder a más detalles sobre el uso de cómputo, como se muestra a continuación.

En esta parte, hemos visto cómo procesar datos usando QuickML, brindándote una variedad de formas efectivas de preparar tus datos para la creación de modelos de aprendizaje automático. Este data pipeline puede reutilizarse para crear múltiples experimentos de ML para casos de uso variados dentro de tu proyecto de Catalyst.

Última actualización 2026-03-20 21:51:56 +0530 IST